郝建颖同学在复振幅调制全息存储研究中获得新进展

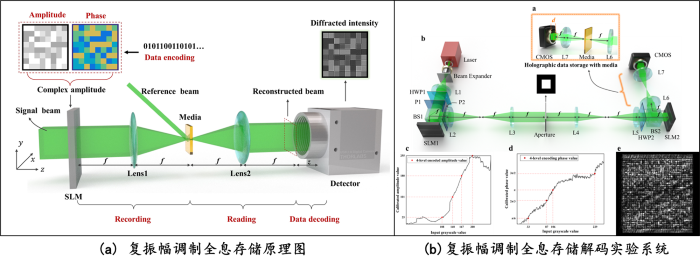

全息存储通过将二维信息保存在三维立体空间中,具有高速度和大容量的特点。然而,传统的基于二值振幅数据页的全息存储系统,由于仅利用了光的二值振幅编码信息,单页存储容量依然有限。随着空间光调制器等光学器件的发展,多级振幅调制,相位调制和复振幅调制等新的全息存储系统被提出。但是,由于相位信息不能被直接探测, 需要从强度图像中计算得到相位数据。传统的迭代方法和干涉方法存在耗时和不稳定的缺点,影响了全息数据存储的相位数据读取速率和解码精度。而对于复振幅调制系统,需要同时实现振幅和相位数据的快速直接读取,难度更大。利用简单的光学系统实现复振幅的快速解码,是保证光全息存储中数据传输速率的关键,也是复振幅全息存储需要解决的问题。本研究提出基于深度学习的复振幅调制全息存储系统以及解调方法,实现了单幅衍射图像的非干涉复振幅重建。该方法利用深度学习提取重建光束的近场衍射特性,并与振幅和相位数据页建立相关关系,实现了简单光学系统下复振幅光场的直接重建。 研究提出的复振幅调制原理以及实验系统如图1所示。待存储信息按照一定的编码规则得到振幅数据页和相位数据页。通过空间光调制器上载数据页调制信息光。记录过程中,调制信息光与参考光发生干涉,全息图被存储在材料中。再现过程中,相同的参考光照射材料,即可获得包含振幅和相位数据页的再现光。该重建系统方法是让重建光继续传播一小段距离,利用探测器捕获衍射强度图像。 |

|

|

|

| 图1. 复振幅调制全息数据存储原理与实验系统 | |

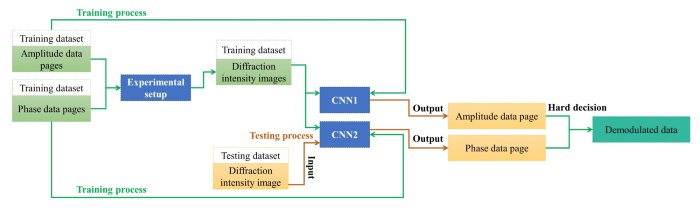

通过生成大量的随机编码振幅和相位图像,并上传到实验系统获得对应的近场衍射强度图像,作为训练集对神经网络进行训练。神经网络训练与复振幅解调过程如图2所示。分别定义两个神经网络CNN1与CNN2。训练过程中,分别将强度-振幅和强度-相位的训练数据输入到CNN1与CNN2,利用训练数据对两个神经网络模型参数进行训练。测试过程中,直接将衍射图像输入到训练后的CNN1与CNN2,即可得到对应的振幅和数据页。通过硬判决得到对应的复振幅数据。 |

|

|

|

| 图2. 神经网络训练与复振幅解解调流程 | |

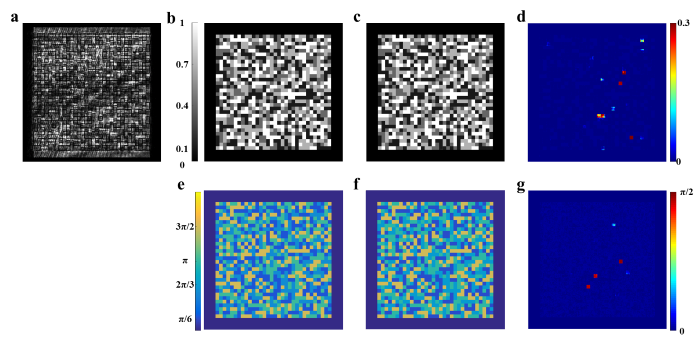

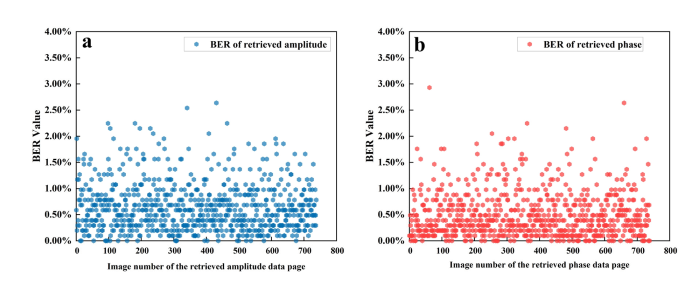

为了验证该方法的可行性,从测试集中随机选择一个衍射强度图像,输入训练后的神经网络,得到的重建结果如图3所示。图3(a)衍射强度图,图3(b)(e) 分别对应的振幅与数据页真值。图3(c)(f)为重建的振幅与数据页。图3(d)(g)分别为重建图像与真值图像的差值,红色区域为预测错误的点。同时,为了验证该方法的泛化能力,对测试集所有的数据页(738幅)进行重建,并计算对应的数据误码率BER(BER = number of error data/total number of data)。 测试数据集误码率分布如图4所示。可以看到对于测试集中所有的振幅和相位数据页,误码率均在3%以下。证明了该方法在复振幅解码的可行性。 |

|

|

|

| 图3. 单幅图像实验重建结果 | |

|

|

| 图4. 测试数据集误码率。(a) 重建振幅数据页误码率分布;(b) 重建相位数据页的误码率分布 | |

本研究提出了一种基于深度学习的复振幅解调方法,能够从单次近场衍射强度图像中直接对振幅和相位数据解码。通过分析近场衍射图像特征与编码数据页之间的相关性,将强度到光场的逆问题分解强度-振幅与强度-相位两个逆过程,并分别用神经网络表示。 在神经网络训练完成后,可以直接从单幅衍射强度图像重建振幅和相位数据页。此外,文中基于编码规则的衍射特征分析为深度学习在计算成像领域的应用研究提供了新的视角。 |

|

|

相关研究成果以“Lensless complex amplitude demodulation based on deep learning in holographic data storage” 发表于1区Top期刊 Opto-Electron Adv 6(3), 220157 (2023)上(IF=14.1)。 论文的相关链接:https://www.oejournal.org/article/doi/10.29026/oea.2023.220157 |

|

|

|

(2023.03.20)